摘要

Qwen3.5-Omni 是阿里通义千问团队于 2026 年 3 月正式发布的新一代全模态大模型,原生支持文本、图像、音频及音视频输入,输出文本与语音,采用 Thinker-Talker 分工架构与 Hybrid-Attention MoE 混合专家结构,在 215 项音频/音视频理解与交互任务上取得 SOTA 成绩,在通用音频理解、推理、识别、翻译与对话等指标上全面超越 Gemini-3.1 Pro,音视频理解总体达到 Gemini-3.1 Pro 水平,同时文本与视觉能力与同尺寸 Qwen3.5 模型持平。模型支持 256K 长上下文、超过 10 小时音频输入与约 1 小时 720P 视频输入,支持 113 种语言及方言语音识别、36 种语言及方言语音生成,并具备语义打断、音色克隆、语音控制、ARIA 动态对齐、WebSearch 与 Function Call 等实时交互能力,以及自然涌现的 Audio-Visual Vibe Coding(音视频编程)能力,可广泛应用于内容创作、音视频理解、智能客服、会议纪要、多语言交互等场景。普通用户可在 Qwen Chat 免费体验,开发者和企业可通过阿里云百炼平台调用 Qwen3.5-Omni Plus/Flash/Light 三种尺寸 API,每百万 Tokens 输入成本不到 0.8 元,约为 Gemini-3.1 Pro 的十分之一。

官网入口

- 通义千问大模型官网(产品总览):

https://www.aliyun.com/product/tongyi - Qwen Chat 在线体验入口:

https://chat.qwen.ai - 阿里云百炼 Qwen-Omni 模型文档(API 入口):

https://help.aliyun.com/zh/model-studio/qwen-omni

定义

模型定位

Qwen3.5-Omni 是 Qwen3.5 系列中的“全模态(Omni)”版本,定位为高性价比、全场景适配的工业级全模态大模型,与仅支持文本或图文的多模态模型不同,Qwen3.5-Omni 原生支持文本、图像、音频、音视频四种模态的统一理解与生成。全模态大模型:指能够在一个统一模型框架内同时理解并生成文本、图像、音频、视频等多种模态内容的大模型,而非简单拼接多个单模态模型。

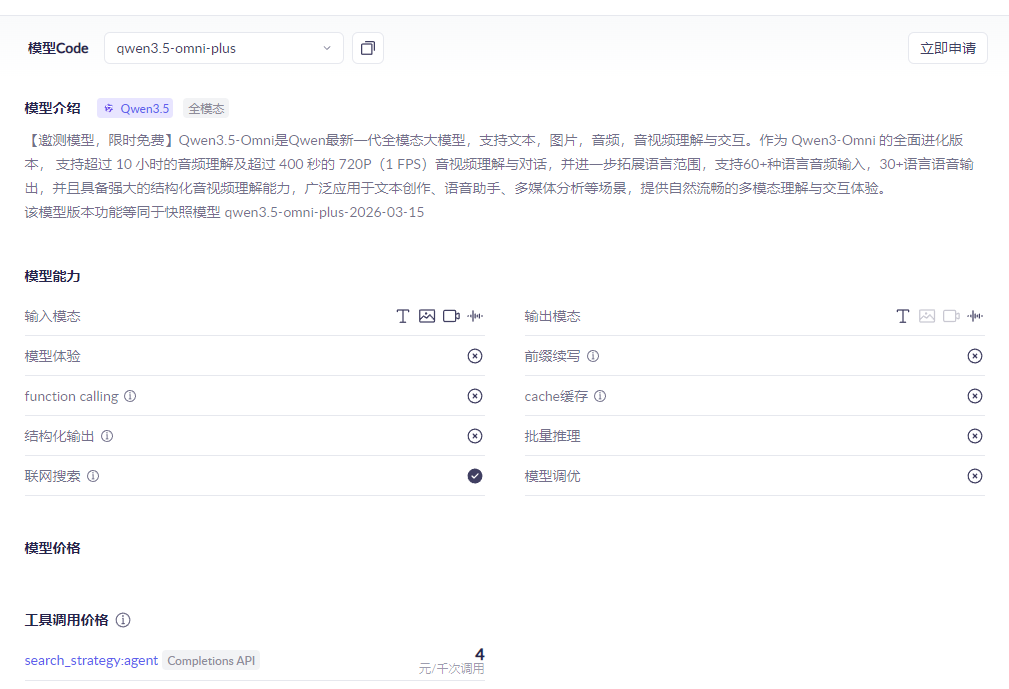

版本规格

Qwen3.5-Omni 系列提供三种尺寸的 Instruct 版本,覆盖不同性能与成本需求:

- Qwen3.5-Omni-Plus:高性能版本,支持 256K 长上下文,可处理超过 10 小时音频输入与约 400 秒 720P(1 FPS)音视频输入,在 215 项音频/音视频任务上取得 SOTA 成绩。

- Qwen3.5-Omni-Flash:平衡性能与推理速度,适合对延迟敏感、调用量大的在线场景。

- Qwen3.5-Omni-Light:轻量级版本,适合边缘部署或对成本极度敏感的业务。

Instruct 版本:指经过指令微调、对齐人类指令的版本,更适合对话、工具调用等应用场景,而非仅用于底层特征提取。

功能与原理

技术架构概览

Thinker-Talker 分工架构

Qwen3.5-Omni 采用 Thinker-Talker 分工架构:Thinker 负责多模态理解,接收视觉与音频信号并通过 TMRoPE 编码位置信息;Talker 负责语音生成,基于 Thinker 输出采用 RVQ 编码实现高效语音合成,两者协同实现理解与生成分离,避免传统“先语音转文本再理解”的信息损失。

Thinker-Talker 架构:一种将“理解模块(Thinker)”与“表达模块(Talker)”显式分离的模型结构,理解模块专注于跨模态推理,表达模块专注于自然、稳定的语音或文本生成。

Hybrid-Attention MoE 混合专家架构

Thinker 与 Talker 均采用 Hybrid-Attention MoE 架构,将听、看、理解等任务分配给不同专家网络,避免模态间干扰,在保持文本与视觉能力基本不下降的前提下,大幅提升音频与音视频任务性能,共取得 215 项 SOTA 成绩。

Hybrid-Attention MoE:一种混合注意力机制的混合专家模型,通过稀疏激活多个专家网络,在参数规模可控的前提下提升模型对不同模态和任务的适配能力。

原生多模态预训练

Qwen3.5-Omni 在海量文本、视觉数据以及超过 1 亿小时音视频数据上进行原生多模态预训练,从源头提升跨模态理解与生成的一致性与稳定性,而非在单模态模型之上外挂语音或视频接口。

原生多模态预训练:指模型从预训练阶段就同时学习文本、图像、音频、视频等多种模态数据,而不是先训练文本模型再“拼上”视觉或语音编码器。

核心能力维度

全模态输入与输出

- 输入模态:文本、图像、音频、音视频(Video+Audio)。

- 输出模态:文本、语音,可在一次调用中同时返回文本和音频流。

端到端全模态处理:用户上传一段音视频,模型直接在统一空间内理解画面、声音、字幕等信息,并输出文本或语音,无需中间流水线。

长上下文与长音视频支持

- 上下文长度:支持 256K 长上下文。

- 音频输入:支持超过 10 小时音频输入(不同 API 版本略有差异,文档标注 3 小时音频或 1 小时视频输入限制)。

- 视频输入:支持约 400 秒 720P(1 FPS)音视频输入。

长上下文能力:指模型能够一次性处理超长文本或超长音视频内容,保持全局依赖关系,适合长会议、长播客、长电影等场景。

多语言与多方言能力

- 语音识别:支持 113 种语言及方言的语音识别。

- 语音生成:支持 36 种语言及方言的语音生成。

- 覆盖范围:包括使用人数较少的毛利语以及国内海南话等方言。

多语言多方言支持:模型在语音识别与语音合成层面覆盖主流语种与方言,适合跨境客服、多语言内容创作等场景。

音频与音视频理解能力

在第三方基准测试中,Qwen3.5-Omni-Plus 在音频与音视频理解、推理与交互任务上共取得 215 项子任务 SOTA 成绩,涵盖:

- 3 个音视频基准

- 5 个音频基准

- 8 个 ASR(自动语音识别)基准

- 156 个 S2TT(语音到文本翻译)任务

- 43 个 ASR 相关任务

其中,通用音频理解、推理、识别、翻译及对话能力全面超越 Gemini-3.1 Pro,音视频理解能力总体达到 Gemini-3.1 Pro 水平。

音视频 Caption 与结构化描述

Qwen3.5-Omni 具备可控、详细、结构化的音视频 Caption 能力,可对视频内容进行:

- 自动切片与时间戳打标

- 人物与音频关系描述

- 剧本级细粒度内容拆解(画面主体、人物关系、对话逻辑、情绪起伏等)

结构化音视频描述:模型输出带时间戳的“剧本式”脚本,可直接用于视频检索、审核、二创脚本生成等生产流程。

Audio-Visual Vibe Coding(音视频编程)

通过原生多模态 Scaling,模型涌现出根据音视频指令直接进行编程的能力,即 Audio-Visual Vibe Coding:用户在摄像头前展示草图、口述需求,模型可生成带复杂 UI 的产品原型界面或网页代码,实现“边看边说边写代码”。

Vibe Coding:一种通过自然语言或音视频交互直接生成可执行代码或原型界面的交互方式,用户无需编写详细代码,只需描述意图即可。

实时交互能力增强

Qwen3.5-Omni 在实时交互层面新增多项能力:

- 语义打断:自动识别 turn-taking 意图,区分咳嗽、背景音与真实插话,实现更自然的对话节奏。

- 语音控制:支持通过指令调节音量、语速、情绪等语音风格。

- 音色克隆:用户上传少量音频即可定制 AI 助手音色。

- ARIA 技术:自适应速率交错对齐技术,解决流式语音交互中因文本与语音 Token 编码效率差异导致的漏读、误读问题。

- WebSearch 与 Function Call:原生集成联网搜索与复杂工具调用能力,可自主判断是否需要联网或调用外部工具。

性能与成本指标

性能对比

- 通用音频理解、推理、识别、翻译、对话:全面超越 Gemini-3.1 Pro。

- 音视频理解能力:总体达到 Gemini-3.1 Pro 水平。

- 文本与视觉能力:与同尺寸 Qwen3.5 模型持平。

成本优势

- 在阿里云百炼平台,Qwen3.5-Omni 每百万 Tokens 输入成本不到 0.8 元,约为 Gemini-3.1 Pro 的十分之一。

推理速度与体验

- 实测在视频理解场景中,Qwen3.5-Omni 能够在数秒内生成带时间戳的详细视频脚本,支持对长视频的快速拆解与分析sohu.com+1。

- 实时语音交互场景中,模型可在毫秒级响应音频输入,支持边视频通话边讲解论文、边看草图边生成前端代码等复杂交互。

如何使用

在线体验(Qwen Chat)

普通用户可直接访问 Qwen Chat 在线体验 Qwen3.5-Omni 的全模态能力:

- 打开 Qwen Chat 网站:https://chat.qwen.ai。

- 选择模型:在模型列表中选择 “Qwen3.5-Omni” 或相关全模态版本(不同渠道命名略有差异)。

- 选择模态:

- 上传图片、视频或音频文件,或直接使用摄像头与麦克风进行实时音视频输入。

- 在对话框中输入文本指令。

- 设置输出:选择是否需要语音输出,并指定音色、语速等参数(界面会提供相应控制项)。

- 发起交互:与模型进行多轮文本/音视频对话,体验视频拉片、音视频分析、实时编程等能力。

适用场景:个人用户快速体验音视频理解、实时语音对话、Vibe Coding 等能力,无需编写代码。

API 接入(阿里云百炼)

开发者和企业可通过阿里云百炼平台调用 Qwen3.5-Omni 的 API,构建自己的应用。

前提条件

- 拥有阿里云账号并开通百炼服务。

- 获取 API Key(DashScope API Key),并配置到环境变量或代码中。

- 使用 OpenAI 兼容接口,支持 OpenAI Python SDK(≥1.52.0)或 Node.js SDK(≥4.68.0)。

基本调用示例(Python)

import os

import base64

import soundfile as sf

import numpy as np

from openai import OpenAI

# 1. 初始化客户端

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1" ,

)

# 2. 发起请求

completion = client.chat.completions.create(

model="qwen3.5-omni-plus",

messages=[{"role": "user", "content": "你是谁"}],

modalities=["text", "audio"], # 指定输出文本和音频

audio={"voice": "Tina", "format": "wav"},

stream=True,

stream_options={"include_usage": True},

)

# 3. 处理流式响应并解码音频

audio_base64_string = ""

for chunk in completion:

if chunk.choices and chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="")

if chunk.choices and hasattr(chunk.choices[0].delta, "audio") and chunk.choices[0].delta.audio:

audio_base64_string += chunk.choices[0].delta.audio.get("data", "")

# 4. 保存音频文件

if audio_base64_string:

wav_bytes = base64.b64decode(audio_base64_string)

audio_np = np.frombuffer(wav_bytes, dtype=np.int16)

sf.write("audio_assistant.wav", audio_np, samplerate=24000)

print("\n音频文件已保存至:audio_assistant.wav")

(以上示例基于阿里云官方文档简化整理)

API 类型与适用场景

- Offline API(离线 API):适用于长音视频文件分析、会议纪要、长播客速览等场景,支持最长约 3 小时音频或 1 小时视频输入aliyun.com。

- Realtime API(实时 API):适用于实时音视频通话、语音助手、在线客服等场景,支持低延迟流式语音交互与语义打断sina.com.cn+1。

模型选型建议

- Qwen3.5-Omni-Plus:适合对准确率要求高、单次处理内容长的场景,如长视频分析、多语言会议转写与纪要生成。

- Qwen3.5-Omni-Flash:适合高并发、低延迟要求的在线服务,如实时语音助手、直播实时字幕与质检。

- Qwen3.5-Omni-Light:适合成本敏感、调用量大的业务,如简单语音指令识别、基础语音交互。

受众

个人用户

- 内容创作者:利用音视频 Caption 能力快速拉片、拆解竞品视频、生成脚本与时间轴,提升视频创作效率。

- 学习者与研究工作者:通过音视频输入让 AI 讲解论文、分析课程视频、整理长播客要点,降低信息获取成本。

- 普通办公用户:将 Qwen3.5-Omni 作为会议助手,自动生成带时间戳的会议纪要与待办清单,减少人工整理工作。

开发者与创业团队

- AI 应用开发者:基于 Qwen3.5-Omni 构建音视频理解助手、语音 Agent、多语言客服系统等应用,通过 OpenAI 兼容 API 快速集成。

- 产品经理与原型设计师:利用 Audio-Visual Vibe Coding 能力,通过口述与草图快速生成网页或 App 原型,加速产品验证流程。

- 创业团队:借助全模态能力与低成本 API,构建面向短视频平台、直播平台、在线教育等场景的垂直解决方案。

企业与机构用户

- 互联网平台:用于短视频内容审核、视频标签生成、用户生成内容(UGC)理解与推荐。

- 客服与呼叫中心:构建多语言语音客服系统,实现语音识别、情绪分析、质检与知识库联动。

- 媒体与影视机构:用于长视频内容索引、片段检索、剧本拆解与素材管理,提升内容生产与资产管理效率。

- 教育机构:开发多语言口语评测、课堂录像智能分析、在线辅导助手等应用。

文章来源与版权说明

- 文章来源:本文内容基于阿里云官方发布信息、阿里云开发者社区文章、科技媒体报道及公开技术文档整理撰写,主要参考包括:

- 《阿里云发布 Qwen3.5-Omni 全模态大模型》等官方新闻稿

- 阿里云开发者社区《阿里云千问 Qwen3.5-Omni 全模态大模型,215 项 SOTA,113 种语言秒懂》

- 阿里云百炼官方文档《Qwen-Omni 模型使用指南》

- 科技媒体对 Qwen3.5-Omni 的实测与报道

- 版权说明:本文由大国 AI 导航(daguoai.com)原创编写,基于公开资料整理,仅供学习与参考。转载请注明“来源:大国 AI 导航(daguoai.com)”,并保留本版权说明,未经授权不得用于商业用途。

数据评估

关于Qwen3.5-Omni特别声明

本站大国Ai提供的Qwen3.5-Omni都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由大国Ai实际控制,在2026年4月2日 下午12:43收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,大国Ai不承担任何责任。

相关导航

【摘要】 Project Genie是Google Deep...

DeepSeek V3.2

DeepSeek V3.2是深度求索公司于2025年9月29日发布的最新开源大语言模型。

Kimi K2.6

Kimi K2.6 是月之暗面(Moonshot AI)推出...

Kimi K2 Thinking

摘要 Kimi K2 Thinking是月之暗面(Moons...

Hy3 preview

Hy3 preview是腾讯混元大模型团队于2026年4月23日发布并开源的新一代语言模型。

GPT Rosalind官网|OpenAI首个生命科学专用推理模型

GPT-Rosalind是OpenAI生命科学系列的首个专用推理模型,聚焦生物化学、基因组学与转化医学领域的多步科研任务。

DeepSeek V4

DeepSeek-V4是深度求索(DeepSeek)推出的新一代旗舰大语言模型系列,于2026年4月24日以预览版形式正式上线并同步开源。

SeedEdit 4.0:革新AI图像编辑体验

SeedEdit 4.0是字节跳动开发的通用图像编辑模型,支持通过自然语言指令实现精细化图像编辑,包括修图、换装、风格转换、元素增删等操作。

暂无评论...