摘要

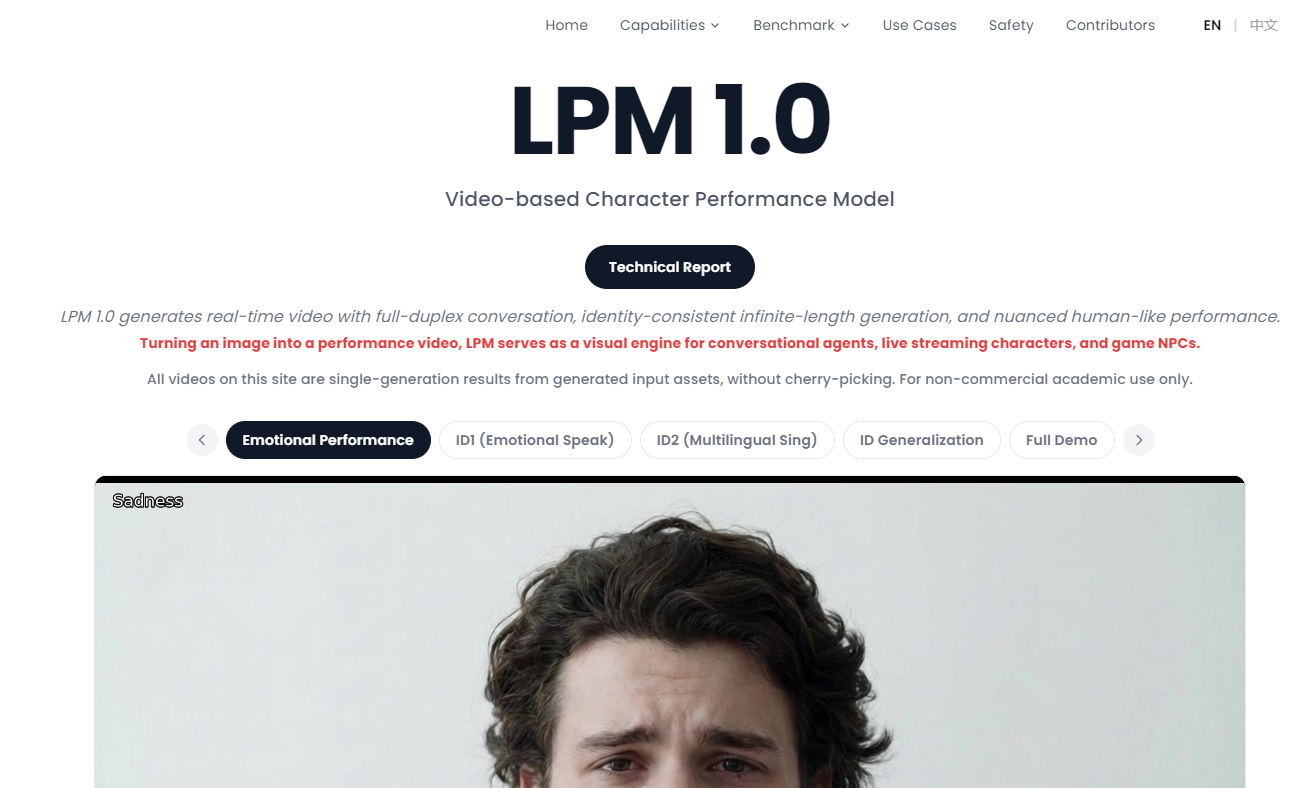

LPM 1.0(Large Performance Model 1.0)是米哈游创始人蔡浩宇旗下 AI 公司 Anuttacon 发布的一款面向“角色表演生成”的视频大模型,参数规模约 170 亿,采用扩散 Transformer(Diffusion Transformer)架构,主打实时、全双工音视频对话与长时间身份稳定生成能力。该模型以“表演”为核心目标,强调说话、倾听、反应与情绪微表情的协同生成,可应用于对话式智能体、虚拟主播、游戏 NPC 等场景。目前 LPM 1.0 处于研究阶段,仅供非商业学术使用,不开放模型权重与 API。本篇将从模型定位、技术架构、核心能力、典型应用与行业影响五个维度进行系统解读。

LPM 1.0的官网地址

- 项目官网:https://large-performance-model.github.io/

- arXiv技术论文:https://arxiv.org/pdf/2604.07823

一、模型定位:从“视频生成”到“角色表演生成”

1.1 LPM 1.0 是什么

- LPM 1.0:Large Performance Model 1.0,面向单人全双工音视频对话的角色表演生成视频模型,由 Anuttacon 团队开发并在 arXiv 公布论文与项目主页。

- 全双工:指在同一时间内可同时完成“说话”与“倾听”的音视频交互,而非单向推送内容。

- 角色表演生成:将对话视为一种“表演”,在画面中同步呈现语音、表情、肢体动作、视线、微表情与情绪变化,使虚拟角色更像“真人”。

该模型不再只关注静态画面或短视频片段的生成,而是强调在长时间互动中维持角色的表现力与身份一致性,并实现低延迟实时生成。1.2 发布背景与研发主体

- 研发主体:Anuttacon,由米哈游创始人蔡浩宇在新加坡创立,专注于 AI 交互式内容与 AGI 产品,首款 AI 游戏《星之低语》已于 2025 年发售。

- 发布形式:2026 年 4 月 9–10 日在 arXiv 发布论文,并同步上线项目主页与若干在线演示视频,展示角色在对话、歌唱、倾听等场景中的表现。

- 当前状态:研究阶段,仅用于非商业学术交流,不发布权重、代码、在线 Demo、API 或产品服务。

1.3 与通用视频生成模型的差异

- 通用视频生成:通常以文本或图像到视频(text/image-to-video)为主,侧重画面内容多样性与视觉效果。

- LPM 1.0:以“表演”为中心,在音视频对话场景中重点解决:

- 说话与倾听行为的连续建模;

- 微表情与肢体动作的自然呈现;

- 实时、可长时间交互的身份稳定性。

二、技术架构:扩散 Transformer 与在线流式生成

2.1 扩散 Transformer(Diffusion Transformer)

- 扩散模型:一类通过“加噪—去噪”迭代过程学习数据分布的生成模型,常用于图像与视频生成,通过从随机噪声逐步恢复出目标内容,实现高保真生成。

- Transformer:以自注意力机制为核心的序列建模架构,可对长程依赖进行统一建模,广泛用于自然语言处理与视觉模型。

- Diffusion Transformer(DiT):将 Transformer 作为扩散模型的主干网络,把空间、时间与条件信息统一为 token 建模,显著提升视频的全局一致性与时序建模能力。

LPM 1.0 的 Base LPM 采用约 170 亿参数的扩散 Transformer 架构,对人物表情、口型、动作以及前后帧连续性进行联合建模。2.2 多模态以人为中心的数据与训练策略

- 多模态以人为中心数据集:通过严格过滤、说话—倾听音视频配对、表演理解标注与身份感知多参考提取构建,用于学习对话中的“表演”规律。

- 多模态条件:将文本、音频、图像等条件统一输入模型,实现一次生成过程中对表情、动作与情绪的联合控制。

这种以人为中心的数据与多模态条件设计,是 LPM 1.0 实现类人表演的重要基础。2.3 Online LPM:因果式流式生成

- 因果式流式生成(Online LPM):将离线 Base LPM 的生成能力通过蒸馏迁移至一个可实时运行的流式生成器,实现低延迟、无限长度的交互。

- 流式推理:模型以“流”的方式逐帧生成视频,适合实时对话与直播场景,避免整段视频生成后再播放带来的明显延迟。

通过 Online LPM,LPM 1.0 可在对话中持续生成视频,而无需“分段拼接”,从而保持长时间的身份与表演一致性。2.4 表演三难(Performance Trilemma)

- 表演三难:LPM 1.0 论文提出的一个概念,指“高表现力、实时推理、长时身份稳定性”三者之间的难以兼得的矛盾。

- 高表现力:动作不重复、情绪细腻、微表情丰富;

- 实时推理:生成速度满足实时交互要求;

- 长时身份稳定性:在数分钟乃至更长时间内保持角色外观、身份与行为一致性。

LPM 1.0 通过大规模多模态数据、扩散 Transformer 与 Online LPM 的架构设计,尝试在这三者之间取得平衡,在保持实时推理的同时实现可观的生成质量与一致性。

三、核心能力与技术指标

3.1 全双工对话与多模态控制

- 全双工对话:模型在同一对话中可同时处理“用户说话—角色倾听”与“角色说话—用户倾听”的双向交互。

- 多模态控制:支持文本、音频、图像三类条件输入,在单次生成中完成对角色动作、表情与情绪的精细控制。

例如,通过文本指令改变角色动作,通过音频语气调节情绪强度,通过参考图像锁定角色外观。3.2 身份保持与长时稳定性

- 多粒度身份条件:全局外观参考、多视角身体图像、面部表情范例等多粒度输入,用于精细刻画角色身份特征。

- 长时稳定性:在线流式架构可在数小时乃至更长时间的交互中保持稳定、身份一致的生成。

相较部分模型仅支持数十秒到数分钟的有界视频,LPM 1.0 在架构设计上支持“无限长度”的身份稳定生成,更适合长时间陪伴与直播场景。3.3 角色泛化与表现力

- 角色泛化:模型接受包括写实真人、2D 动漫、3D 游戏角色、非人形生物在内的多种角色输入,无需针对特定风格微调即可生成表演视频。

- 表现力:支持对话、演唱、倾听、沉默待机等多种对话状态,并在不同场景中呈现节奏、呼吸、视线与微表情等类人行为。

项目演示中,模型可配合 ChatGPT、豆包等音频到音频(A2A)模型,实现即插即用的“语音对话+视频表演”联合 pipeline。3.4 LPM-Bench:角色表演基准

- LPM-Bench:由 LPM 1.0 团队提出的首个面向交互式角色表演的基准测试,涵盖表现力、身份稳定性、对话连贯性等多个维度。

- 评测结果:论文称 LPM 1.0 在所有评估维度上取得最优结果,同时保持实时推理能力。

四、典型应用场景

4.1 对话式 AI 智能体

- 视觉引擎:LPM 1.0 可作为对话式智能体的视觉前端,将 LLM/A2A 模型的语音回复实时转化为角色的说话与倾听视频。

- 场景示例:虚拟客服、语音助手、教育辅导等需要“面对面交流”的场景,通过视频提升交互真实感与陪伴感。

4.2 虚拟主播与直播角色

- 全双工直播:模型可在长时间直播中持续生成角色视频,与弹幕或语音实时互动,无需预先录制大量动画片段。

- 表现能力:演唱、吐槽、倾听、情绪切换等“直播常见行为”均可由模型实时驱动。

4.3 游戏智能 NPC 与游戏陪伴

- 智能化 NPC:在开放世界或剧情向游戏中,NPC 可具备实时对话、情绪反应与表演能力,提升沉浸感与可玩性。

- 游戏陪伴:通过长时间对话与身份稳定生成,打造“陪伴型”虚拟角色,为玩家提供持续互动体验。

4.4 其他交互式内容

- 教育与个性化辅导:虚拟教师可根据学生语音与表情实时调整讲解节奏与表达方式。

- 娱乐内容陪伴:虚拟偶像、虚拟角色、互动剧集等,通过实时生成提升用户参与度与沉浸感。

五、局限性与开放策略

5.1 技术局限与风险

- 可检测性:项目主页指出,当前生成视频中仍存在可识别的生成痕迹,与真实视频相比仍存在可被检测的差距。

- 潜在风险:若被不当使用,可能存在深度伪造、冒充他人等风险,团队明确反对任何针对真实个人的误导性或有害内容生成。

5.2 不开放权重与接口

- 不开放内容:模型权重、源代码、在线演示、API、产品或任何相关服务均暂不对外提供。

- 使用限制:当前仅限非商业学术使用,未来是否开放将视安全与负责任使用框架的成熟度而定。

这一策略意味着开发者目前无法直接调用 LPM 1.0,只能通过论文与项目主页了解其技术路线与能力边界。

六、对行业的影响与趋势

6.1 从“内容生成”到“表演驱动的交互”

- 传统 AIGC:侧重生成静态图片、短视频或文本。

- 表演驱动交互:将“表演”视为核心,通过音视频对话实现持续交互,推动虚拟角色从“播放器”升级为“参与者”。

LPM 1.0 的发布表明,大模型正在从“内容工具”向“交互伙伴”演进,对游戏、直播、教育等互动娱乐领域具有示范意义。6.2 与米哈游“游戏+AI”路线的衔接

- 米哈游已在《星布谷地》等项目中探索智能 NPC 与玩家互动,LPM 1.0 可为未来 AI 原生游戏提供统一的“角色表演视觉引擎”。

- 从数字人“鹿鸣”到 LPM 1.0,米哈游持续在虚拟角色与交互体验上进行投入,为长期构建 AI 原生娱乐生态打基础。

七、小结:如何看待 LPM 1.0 的价值

从技术角度看,LPM 1.0 在扩散 Transformer 与在线流式生成的框架下,尝试在“表现力—实时性—长时稳定性”之间寻找平衡,并在角色表演生成这一细分方向上给出了较完整的解决方案。从应用角度看,它将视频生成从“短内容”拉向“长交互”,为对话式智能体、虚拟主播与游戏 NPC 等场景提供了新的技术路径。从行业角度看,LPM 1.0 的出现标志着“表演驱动”的 AI 交互开始成为视频大模型的重要发展方向之一,对于关注 AI 娱乐与游戏生态的开发者与研究者具有较高的参考价值。

文章来源与版权说明

- 主要信息来源:

- LPM 1.0 论文 arXiv 页面(2604.07823),标题为《LPM 1.0: Video-based Character Performance Model》。

- LPM 1.0 官方项目主页(large-performance-model.github.io)。

- 国内多家科技媒体的报道,包括 IT 之家、搜狐科技/游戏陀螺、证券时报等,用于交叉确认时间线、参数规模与应用场景描述。

- 版权说明:

- 本文为基于公开资料的二次创作科普文章,仅用于信息传播与学术交流。

- 文中涉及的模型名称、架构描述、应用场景等均来自上述公开来源,版权归原作者与相关机构所有。

- 未经授权,不得将本文用于商业用途或大规模机器采集与再发布。如需转载或引用,请注明出处并保留原文版权声明。

(作者:大国Ai导航,站点:daguoai.com)

数据评估

关于LPM 1.0特别声明

本站大国Ai提供的LPM 1.0都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由大国Ai实际控制,在2026年4月13日 上午11:22收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,大国Ai不承担任何责任。

相关导航

Seko AI是由商汤科技推出的全球首个创编一体的AI短视频创作智能体,致力于让零基础用户也能通过自然语言对话生成高质量短片。

Sora视频

Sora AI由OpenAI于2024年2月发布,是全球首个...

Grok Imagine

Grok Imagine 是埃隆·马斯克旗下xAI团队开发的AI文本转视频生成工具,被誉为“AI版Vine”。它通过自然语言描述快速生成高质量短视频,支持实时渲染、音效同步及多模态交互,重新定义了内容创作的边界。

呜哩AI

提供图片生成、视频生成、图像编辑等功能,旨在为内容创作者、设计师、营销人员提供高效多元的创意生成解决方案。

Gemini Omni

Gemini Omni 是 Google 在 Gemini 生态中的下一代统一多模态视频模型。

HappyHorse

HappyHorse-1.0是全球首个登顶文生视频和图生视频双榜的开源AI模型,支持150亿参数原生音视频联合生成,1080p约38秒输出,具备7语言唇形同步能力。

Medeo

Medeo 是先进的AI视频创作平台,能帮助创作者轻松将创意转化为专业视频。用户只需输入文字描述,Medeo 能自动拆分镜头、生成脚本,从海量素材库中精准匹配画面,添加专业配音和背景音乐,快速生成完整视频。

Sora 2

OpenAI Sora 2是人工智能领域的最新力作,作为第二代文本到视频生成模型,它在视频质量、物理规律理解和用户体验方面实现了显著提升。

暂无评论...